KI macht nicht alles besser. Hand aufs Herz: Die folgenden Phänomene sind uns allen schon begegnet, und wir haben uns darüber geärgert oder uns zumindest über sie gewundert. Wer auf LinkedIn scrollt, dem sind die unzähligen Infografiken und Karussells aufgefallen. Alle schön anzusehen, mit immer gleichem Inhalt und ähnlichem Aufbau. Optimierte Textblöcke und Bilder mit gleichbleibender ästhetischer Anmutung. Vieles davon wirkt zwar optisch ansprechend, aber gleichzeitig gänzlich leblos. Das Gefühl, dass mit diesen Inhalten etwas nicht ganz stimmt, ist latent.

Und wer kennt sie nicht, die E-Mails, die mit Formulierungen beginnen, die im deutschen Sprachraum so nie gebräuchlich waren? Etwa die Frage nach dem persönlichen Wohlbefinden. Danke der Nachfrage – an die KI.

Das sind nur zwei Beispiele, wie wir täglich mit dem Output von KI-Systemen konfrontiert werden. Zwei von der Sorte, an denen man sich anstößt, an die man sich aber schon gewöhnt hat und über die man mittlerweile hinwegscrollt. Die KI-Fatigue ist real. Der Begriff beschreibt eine Mischung aus KI-Müdigkeit, Reizüberflutung und kognitiver Erschöpfung, die aus der ständigen Konfrontation mit KI und ihren Ergebnissen entsteht.

Dieser Beitrag ordnet das Phänomen ein. Die These dahinter: KI-Fatigue wird vor allem als ein individuelles Problem verstanden. Wer erschöpft ist, soll Pausen machen, Grenzen setzen und, ein weiterer gern gemachter Vorschlag in diesem Kontext, soll KI bewusster nutzen.

Unsere Vermutung: Diese Empfehlungen greifen zu kurz, und das Problem geht über das individuelle Missempfinden hinaus. Die eigentliche Ursache liegt in einem strukturellen Mismatch zwischen der Logik, mit der KI funktioniert, und der Logik, mit der Organisationen arbeiten. Damit KI-Fatigue nicht zum Dauerzustand und zu einer Beeinträchtigung wird, braucht es ein anderes Bewusstsein und eine Anpassung der organisatorischen Strukturen.

TL;DR:

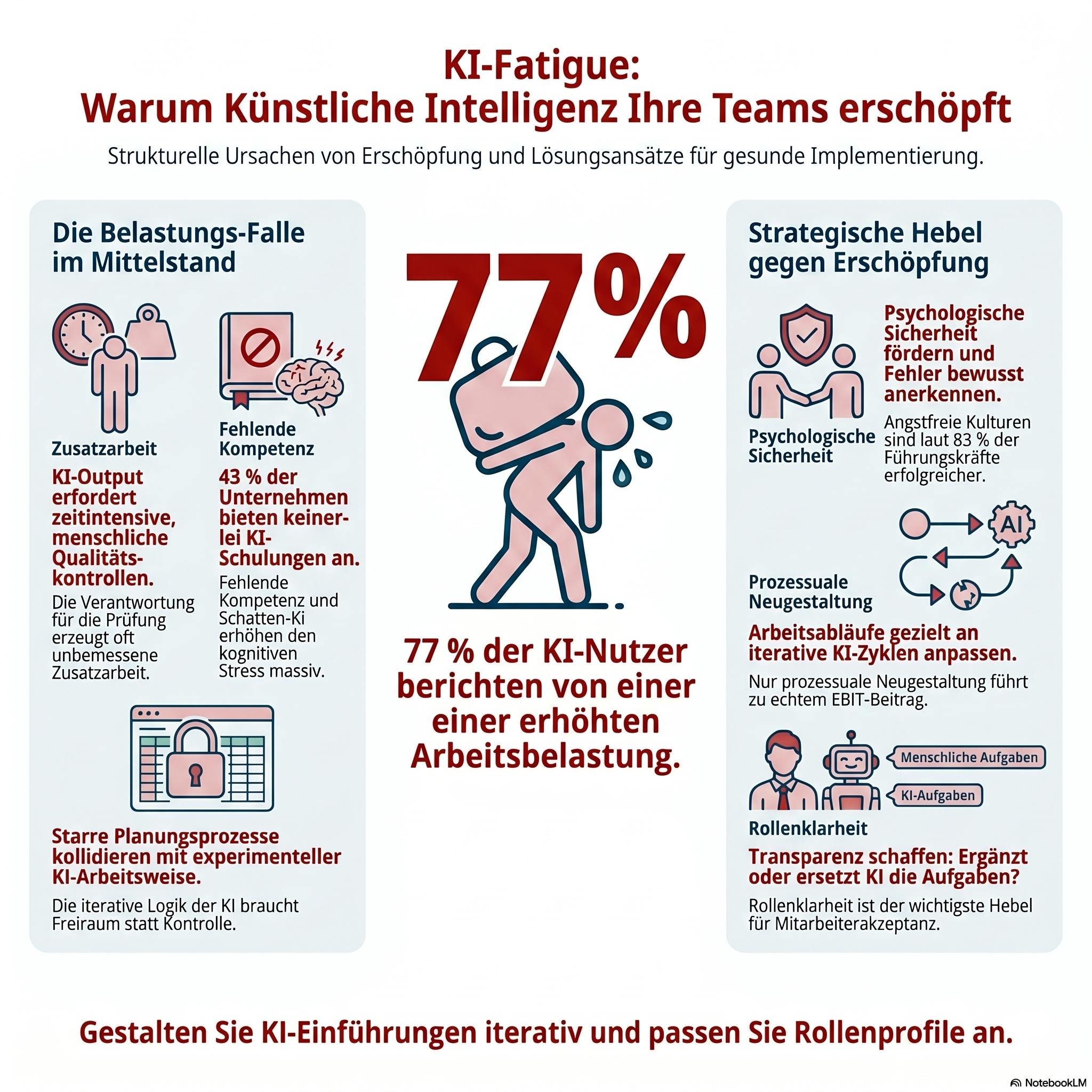

KI-Fatigue bezeichnet die Erschöpfung, die aus der Dauerkonfrontation mit KI entsteht. Sie wird meist als individuelles Problem verhandelt, ist aber strukturell. Die Forschung zu Technostress beschreibt seit über 40 Jahren ähnliche Muster. Neu ist die Beschleunigung durch KI. Belastend wird sie vor allem dort, wo Menschen individuell längst mit KI arbeiten, während ihre Organisationen noch in Kontrollroutinen verharren. KI-Logik funktioniert iterativ, viele Organisationen funktionieren planerisch. Dieser Widerspruch ist der eigentliche Treiber der Ermüdung. Organisationen, die KI nachhaltig nutzen wollen, müssen an fünf Stellen ansetzen: psychologische Sicherheit als Voraussetzung verstehen, Transparenz zu Auswirkungen auf Rollen und Aufgaben schaffen, Arbeitsabläufe neu gestalten statt nur Tools ausrollen, Kompetenzen systematisch aufbauen und die Einführung iterativ gestalten.

Was ist KI-Fatigue und was sind die Ursachen?

KI-Fatigue, oder auch AI-Fatigue, wird als stehender Begriff verwendet. In Studien, Branchenmedien und auf Plattformen wie LinkedIn kursiert er seit 2023, um ein ganzes Bündel aus Symptomen zu beschreiben: mentale Erschöpfung durch ständige KI-Interaktion, Frustration über KI-generierten Inhalt, Bewertungsdruck beim Durchsehen von KI-Ergebnissen, das Gefühl, dank KI immer mehr leisten zu können, aber gleichzeitig auch noch mehr leisten zu müssen.

KI-Fatigue ist als Begriff noch jung, aber das Phänomen dahinter ist real und messbar. Aus der psychologischen Perspektive betrachtet beschreibt der vor mehr als 40 Jahren geprägte Begriff Technostress jene Belastungen, die durch Informationstechnologie am Arbeitsplatz entstehen. Operationalisiert wurde der Begriff 2007 von Monideepa Tarafdar und Kolleginnen in der viel zitierten Studie The Impact of Technostress on Role Stress and Productivity im Journal of Management Information Systems [1]. Sie identifizierten fünf Stressoren: Techno-Überlastung, Techno-Invasion, Techno-Komplexität, Techno-Verunsicherung (bezogen auf den Arbeitsplatz) und Techno-Unsicherheit (bezogen auf die Technik selbst).

Ein systematisches Review von Sapkota und Kollegen aus dem Jahr 2025 zeigt, dass KI diese klassischen Stressoren verstärkt und weitere Faktoren hinzufügt [2]. Dazu gehören die Unvorhersagbarkeit generativer Modelle, das Risiko von KI-Halluzinationen, ethische Konflikte beim Einsatz von KI sowie die Angst vor schleichendem Kompetenzverlust durch künstliche Intelligenz.

Die Autoren werteten 66 Studien systematisch aus. Ihr Befund: KI erzeugt keine neue Pathologie, sondern eine neue Intensität eines bereits bekannten Phänomens.

Wie stark diese Beschleunigung tatsächlich wirkt, zeigen mehrere voneinander unabhängige Erhebungen. Eine gemessen an der Geschwindigkeit, mit der sich KI entwickelt, schon beinahe historisch anmutende Befragung des Arbeitsmarkt-Marktplatzes Upwork aus dem Jahr 2024 ergab, dass 77 Prozent der KI-nutzenden Beschäftigten berichteten, KI-Tools hätten ihre Arbeitsbelastung erhöht, nicht verringert [3].

Eine über acht Monate laufende Feldstudie der University of California, Berkeley, zur Arbeitsgewohnheit unter KI-Einführung zeigt, dass natürliche Pausen im Arbeitstag systematisch erodieren, sobald KI-Tools bereitstehen [4]. Diese Beobachtungen haben wir in unserem Beitrag „KI entlastet und verführt gleichzeitig zu Mehrarbeit“ bereits eingeordnet.

Der zentrale Punkt für die weitere Argumentation: KI-Fatigue entsteht nicht, weil KI schlecht funktioniert. Sie entsteht, weil KI so gut funktioniert, dass die etablierten Rahmenbedingungen in Organisationen dieser neuen Form von Wissensarbeit nicht mehr genügen.

Sind Mitarbeitende bereits weiter als ihre Organisationen?

Wer sich die Adoptionsdaten zu KI in Deutschland anschaut, findet ein auffälliges Muster. Auf der individuellen Ebene ist KI angekommen. Auf der organisationsweiten Ebene hinkt Deutschland im europäischen und internationalen Vergleich hinterher. Und: Die Schere zwischen beiden Ebenen wird größer und schließt sich nicht etwa.

Der BCG-Report „AI at Work 2025“ zeigt für Deutschland eine wöchentliche individuelle KI-Nutzung von 64 Prozent unter befragten Wissensarbeitenden. Zum Vergleich: In den USA liegt der Wert bei 51 Prozent [5]. Deutsche Beschäftigte nutzen KI individuell also nicht weniger, sondern häufiger als ihre US-Kollegen.

Gute Nachrichten gibt es auch bei der organisationsweiten Betrachtung: Die Bitkom-Studie Durchbruch bei Künstlicher Intelligenz vom September 2025 zeigt, dass 36 Prozent der deutschen Unternehmen KI einsetzen [6]. Das ist eine Verdopplung gegenüber den Zahlen aus dem Jahr 2024.

Genauso wichtig sind aber auch folgende Datenpunkte, die für das Thema KI-Fatigue entscheidend sein können:

- Nur acht Prozent der Unternehmen bieten KI-Schulungen für alle Beschäftigten an. 43 Prozent bieten überhaupt keine Schulung an [6].

- Das Institut der deutschen Wirtschaft weist in seinem Report „KI als Wettbewerbsfaktor“ aus dem Jahr 2025 aus, dass nur sechs Prozent der Unternehmen KI in mehreren Geschäftsbereichen einsetzen [7]. Der Rest arbeitet mit Insellösungen.

Weitere Einordnungen zu den organisatorischen Herausforderungen haben wir in unserem Beitrag zur KI-Transformationsmatrix zusammengestellt.

In der Zusammenschau ergibt sich ein fast paradoxes Bild. Eine weitere Bitkom-Erhebung vom Oktober 2025 unter 604 Unternehmen bestätigt die Schere: 42 Prozent der Unternehmen gehen davon aus, dass ihre Beschäftigten private KI-Tools im Job nutzen. In acht Prozent ist das weitverbreitet, eine Verdopplung gegenüber 2024 [8]. Nur 23 Prozent der Unternehmen haben überhaupt Regeln für den KI-Einsatz aufgestellt. Nur 26 Prozent stellen ihren Beschäftigten offiziellen Zugang zu generativer KI bereit.

Die Lage in der Zusammenfassung: Mitarbeitende in deutschen Unternehmen nutzen KI oft intensiv, auch ohne offizielle Freigabe. Ihre Arbeitgeber haben die strukturellen Voraussetzungen für diese Nutzung vielfach noch nicht geschaffen. Schulungen fehlen genauso wie klare Richtlinien und integrierte Prozesse.

Diese Lücke ist ein zentraler, aber nicht der einzige Treiber von KI-Fatigue. Selbst dort, wo Unternehmen KI offiziell bereitstellen, kann Ermüdung entstehen, wenn Arbeitsabläufe nicht angepasst werden, Schulungen nur oberflächlich bleiben oder eine Kultur der Kontrolle die iterative Logik von KI blockiert.

Warum kollidiert KI-Logik mit der Logik vieler Organisationen?

Vielleicht liegt darin der strukturelle Kern des Problems. KI folgt einer anderen Logik als die etablierten Prozesse in vielen Organisationen.

Die Logik von KI ist Iteration. Jeder, der mit KI gearbeitet hat, kennt das aus eigener Erfahrung nur zu gut. Die Ergebnisse sind nie beim ersten Anlauf perfekt. Vielmehr vollzieht sich ein Zyklus aus Hypothese, Prompt, Ergebnis, Anpassung, erneutem Versuch. Jeder dieser Schritte ist mit Unsicherheiten behaftet. Die Ergebnisse sind nicht deterministisch. Qualität entsteht durch Wiederholung, Variation, Vergleich und durch das Schaffen von Kontext und Referenzen für die KI. Kurz: Produktive KI-Arbeit ist über weite Strecken auch experimentelle Arbeit.

Die Logik vieler Organisationen ist dagegen geprägt von einem Ansatz, der weitestgehend als „Kontrolle“ bezeichnet werden kann. Planung, Absicherung, Freigabeschleifen, Dokumentation. Unsicherheit wird so weit wie möglich reduziert, nicht kultiviert. Stabilität entsteht durch Vorhersagbarkeit. Produktive Arbeit ist Arbeit nach Plan. Ambiguität wird so gut es geht ausgeschlossen.

Beide Logiken sind für sich genommen absolut nachvollziehbar. Ihre Koexistenz kann aber Reibung schaffen, wenn die verschiedenen Ebenen nicht bewusst verzahnt werden. Und genau diese Reibung kann ebenfalls zu KI-Fatigue beitragen.

Diese Reibung ist nicht neu. Vielmehr ist sie eine normale Begleiterscheinung jeder Innovation, die sich ihren Weg bahnt. Neu ist, wie schnell sie in der täglichen Arbeit sichtbar wird, sobald KI ins Spiel kommt. Eine von MIT Technology Review Insights im Auftrag von Infosys Topaz durchgeführte Befragung von 500 Führungskräften weltweit aus dem Dezember 2025 kommt zu dem Ergebnis, dass psychologische Barrieren inzwischen stärker wirken als technische, wenn es um die erfolgreiche Einführung von KI geht [9]. 83 Prozent der Executives gaben an, eine Kultur mit ausgeprägter psychologischer Sicherheit verbessere den Erfolg von KI-Initiativen messbar.

Die Befunde dieser Befragung ordnen sich in eine wissenschaftliche Tradition ein, die deutlich älter ist. Die Harvard-Wirtschaftswissenschaftlerin Amy Edmondson hat das Konzept der psychologischen Sicherheit bereits 1999 in der Administrative Science Quarterly formuliert [10]. In einer Feldstudie von 51 Teams zeigte sie, dass Teams dann lernen, wenn ihre Mitglieder Fehler melden, Fragen stellen und abweichende Perspektiven einbringen können, ohne soziale Konsequenzen zu fürchten. In ihrem Buch The Fearless Organization aus dem Jahr 2018 weitet sie dieses Konzept auf ganze Organisationen aus [11].

Die Kombination dieser Befunde zeigt: Psychologische Sicherheit gehört nicht mehr in die Rubrik weicher Kulturfaktoren. Sie wirkt als Voraussetzung dafür, dass KI-Initiativen in der Organisation ankommen können und nicht in persönliche Ermüdung umschlagen.

Warum verstärkt dieser Mismatch die KI-Fatigue?

Wer täglich KI nutzen soll, aber in Organisationsstrukturen eingebunden ist, die nicht auf eine iterative Herangehensweise ausgelegt sind, zahlt womöglich einen kognitiven Preis dafür.

Drei Muster treten dabei regelmäßig auf:

- Review-Last ohne Rückendeckung. KI erzeugt in kurzer Zeit Ergebnisse. Die Verantwortung für die Qualitätssicherung bleibt aber beim Menschen. Wenn die Organisation keine Zeitbudgets für diese Prüfungen berücksichtigt, entsteht eine unsichtbare Zusatzarbeit. Das Mehr an Output fühlt sich natürlich produktiv an. Die Erschöpfung am Abend lässt sich hingegen schwerer einordnen. Die Microsoft-365-Telemetrie aus dem Frühjahr 2025 dokumentiert, dass Wissensarbeitende im Schnitt alle zwei Minuten durch Meetings, E-Mails oder Chats unterbrochen werden [12]. Diese bereits fragmentierte Aufmerksamkeit trifft nun auf KI, die als zusätzliche Anforderungsebene wirkt. Prüfen, Einordnen, Entscheiden, Korrigieren.

- Shadow AI als Ausweichverhalten. Die bereits zitierte Bitkom-Erhebung aus dem Oktober 2025 zeigt, dass in 42 Prozent der deutschen Unternehmen private KI-Tools im Job eingesetzt werden [8]. Das ist kein Zeichen schlechter Absicht, sondern eine Reaktion auf fehlende offizielle Wege. Wer Shadow AI nutzt, trägt nicht nur die Verantwortung für das Ergebnis, sondern auch für Datenschutz, Compliance und Einordnung. Ein dauerhafter Zustand stiller Eigenverantwortung erzeugt kognitive Belastung.

- Permanenter Rollenwechsel zwischen Ausführung und Aufsicht. Die Koordination paralleler KI-Prozesse ist Managementarbeit, auch wenn sie von Sachbearbeitenden verlangt wird. Welche Instanz benötigt gerade Input? Wo ist ein Ergebnis zu prüfen? Welche Aufgabe hat Priorität? Diese Koordinationsleistung wurde in der Prä-KI-Zeit selten verlangt und ist in so gut wie keinem Aufgabenprofil systematisch abgebildet. Eine Einordnung dieser neuen Anforderungen haben wir im Beitrag „KI macht uns produktiver und genau darin liegt eine Gefahr“ vorgenommen.

Alle drei Muster haben eine gemeinsame Ursache. Die Organisation erwartet den Nutzen der KI, hat aber noch nicht verstanden, dass dafür neue Rahmenbedingungen geschaffen werden müssen, damit dieser Nutzen ohne persönliche Erosion realisiert werden kann.

Was können Organisationen verändern, um KI-Fatigue zu vermeiden?

Wenn KI-Fatigue tatsächlich ein strukturelles Problem ist, dann sind individuelle Gegenmaßnahmen voraussichtlich nur begrenzt wirksam. Organisationen, die nachhaltig mit KI arbeiten wollen, stehen vor fünf Aufgaben:

- Psychologische Sicherheit als Voraussetzung schaffen: Das bedeutet nicht, Widerspruch bloß zu tolerieren. Es bedeutet, Fehler im Umgang mit KI bewusst anzuerkennen, zu analysieren und daraus zu lernen. Die MIT-Insights/Infosys-Befragung weist aus, dass 22 Prozent der Executives zugegeben haben, aus Angst vor Schuldzuweisung kein KI-Projekt initiiert zu haben [9]. In einer Organisation, die offen mit Fehlschlägen umgeht, entstehen solche Blockaden seltener.

- Transparenz zu Auswirkungen auf Rollen und Aufgaben schaffen: In derselben Befragung nannten 60 Prozent der Executives Klarheit über die konkrete Wirkung von KI auf Rollen und Aufgaben als wichtigsten Hebel für psychologische Sicherheit [9]. Wer nicht weiß, ob seine Arbeit durch KI ergänzt oder ersetzt werden soll, wird bei der Zusammenarbeit mit KI gehemmt sein. Diese Klarheit zu schaffen, ist eine Führungsaufgabe, nicht die Aufgabe von HR. Fehlende Klarheit erzeugt hier Dauerstress, der sich ebenfalls als Ermüdung zeigen kann.

- Arbeitsabläufe neu gestalten statt nur neue Tools auszurollen: Die State-of-AI-Studie von McKinsey aus November 2025 identifiziert die bewusste Neugestaltung von Arbeitsabläufen als den stärksten einzelnen Faktor für messbaren EBIT-Beitrag von KI [13]. Unternehmen, die ihre Prozesse nicht anpassen, erzeugen durch KI primär zusätzliche Arbeit, keine Entlastung. Wir haben diesen Punkt in unserem Beitrag „Change Management, der unterschätzte Erfolgsfaktor bei KI-Implementierungen“ ausführlich behandelt. Ohne Redesign bleibt KI-Fatigue die logische Folge.

- Kompetenzaufbau, der trägt: Schulungen allein reichen nicht. Beschäftigte müssen dazu befähigt werden, KI souverän und in ihrem spezifischen Arbeitskontext nutzen zu können. Das ist der gleiche Befund, den die RBC-/Munk-School-Studie zur Imagination Gap aus dem Jahr 2025 ausweist. Wer das eigene Fachgebiet beherrscht, kann KI sinnvoll einsetzen. Genauso wichtig ist es, ein Bewusstsein dafür zu schaffen, dass die KI dazu verlockt, in „fremden“ Fachgebieten zu wildern. Die gefühlte Omnipotenz von KI und die von ihr erzeugten Ergebnisse müssen aber auch eingeordnet und überprüft werden können. Hier schließt sich der Kreis zur eigenen Prüfungskompetenz.

- Die Einführung iterativ gestalten: Wer KI einführt wie ein klassisches IT-Projekt, wiederholt den Mismatch zwischen Organisations- und KI-Logik auf der Metaebene. Ein großer Rollout mit fixem Go-live-Datum, festen Lastenheften und verbindlichen Vorabplanungen passt nicht zu einer Technologie, deren Nutzen sich erst durch Erprobung zeigt. Sinnvoller sind überschaubare Einführungszyklen mit klar umrissenen Use Cases, expliziten Lernschleifen und der bewussten Erlaubnis, Erkenntnisse aus dem ersten Zyklus in die Gestaltung des zweiten einfließen zu lassen. Das nimmt Druck aus dem System und reduziert die Erschöpfung, die entsteht, wenn Beschäftigte ein planerisch aufgesetztes Vorhaben iterativ zum Funktionieren bringen sollen.

Die fünf Stellschrauben greifen ineinander. Wer psychologische Sicherheit aufbaut, aber Arbeitsabläufe unverändert lässt, verbessert vordergründig das Betriebsklima, ohne die KI-Fatigue zu beachten, die wiederum eine Erosion des Betriebsklimas durch die Hintertüre bedeuten kann. Wer Workflows neu gestaltet, aber die Auswirkungen auf Rollen und Aufgaben nicht transparent macht, erzeugt ebenfalls Widerstand. Wer zwar die notwendigen Kompetenzen aufbaut, gleichzeitig aber keine iterative Arbeitsweise zulässt, produziert am Ende Frust.

Was der Mittelstand von alledem mitnehmen kann

Für den Mittelstand zählen Ansätze, die in der Praxis funktionieren, mit Indikatoren, die ebenso praktisch gemessen werden können. Aus dieser Perspektive betrachtet ist KI-Fatigue ein Signal, nicht ein unabwendbares Schicksal. Wo Erschöpfung bei Beschäftigten sichtbar wird, die mit KI arbeiten, liegt die Ursache in den seltensten Fällen bei den Personen selbst. Sie liegt in den Rahmenbedingungen, die optimiert werden können.

Der Mittelstand hat Vorteile, die Großunternehmen nicht in diesem Maße haben. Kürzere Entscheidungswege, flachere Hierarchien, direkter Draht zwischen Führung und Umsetzung. Genau diese Vorteile helfen beim Umbau von Strukturen. KI-Implementierung funktioniert nicht als Software-Rollout, sondern viel eher als Arbeit an der Unternehmenskultur mit einer stark ausgeprägten technologischen Komponente.

Die angesprochene mögliche Entscheidungsgeschwindigkeit im Mittelstand kann jedoch auch ein zweischneidiges Schwert sein. Schnelligkeit ohne systematische Vorbereitung führt zu Aktivismus: viele Tools, wenig Wirkung, wachsende Frustration. Die Vorteile der Geschwindigkeit spielen sich erst dann aus, wenn sie auch mit Klarheit über Ziele, Rollen und Prozesse verbunden sind. Die oben angesprochenen Hebel liefern dafür erste Denkanstöße für eine pragmatische KI-Implementierung.

Quellen

[1] Tarafdar, M., Tu, Q., Ragu-Nathan, B. S., & Ragu-Nathan, T. S. (2007). The Impact of Technostress on Role Stress and Productivity. Journal of Management Information Systems, 24(1), 301–328. https://doi.org/10.2753/MIS0742-1222240109

[2] Sapkota, N., Makkonen, M., Pirkkalainen, H., & Salo, M. (2025). From Technostressors to AI-Stressors: A Systematic Literature Review. CEUR-WS Vol-4134. https://ceur-ws.org/Vol-4134/

[3] Upwork Research Institute (2024). From Burnout to Balance: AI-Enhanced Work Models for the Future. https://www.upwork.com/research/ai-enhanced-work-models

[4] Ranganathan, A., & Ye, X. M. (2025). AI Doesn’t Reduce Work, It Intensifies It. Harvard Business Review.

[5] Boston Consulting Group (2025). AI at Work 2025: Momentum Builds, but Gaps Remain. https://www.bcg.com/publications/2025/ai-at-work-momentum-builds-but-gaps-remain

[6] Bitkom (2025). Durchbruch bei Künstlicher Intelligenz. https://www.bitkom.org/Presse/Presseinformation/Durchbruch-Kuenstliche-Intelligenz

[7] Institut der deutschen Wirtschaft (2025). Künstliche Intelligenz als Wettbewerbsfaktor. https://www.iwkoeln.de/fileadmin/user_upload/Studien/Report/PDF/2025/IW-Report_2025-KI-als-Wettbewerbsfaktor.pdf

[8] Bitkom (2025). Beschäftigte nutzen vermehrt Schatten-KI. Repräsentative Befragung von 604 Unternehmen in Deutschland ab 20 Beschäftigten. https://www.bitkom.org/Presse/Presseinformation/Beschaeftigte-nutzen-Schatten-KI

[9] MIT Technology Review Insights in Partnership with Infosys Topaz (2025). Creating Psychological Safety in the AI Era. https://www.technologyreview.com/2025/12/16/1125899/creating-psychological-safety-in-the-ai-era/

[10] Edmondson, A. C. (1999). Psychological Safety and Learning Behavior in Work Teams. Administrative Science Quarterly, 44(2), 350–383. https://doi.org/10.2307/2666999

[11] Edmondson, A. C. (2018). The Fearless Organization: Creating Psychological Safety in the Workplace for Learning, Innovation, and Growth. Wiley.

[12] Microsoft (2025). Breaking Down the Infinite Workday. Work Trend Index Special Report. https://www.microsoft.com/en-us/worklab/work-trend-index/breaking-down-infinite-workday

[13] McKinsey & Company (2025). The State of AI: Agents, Innovation, and Transformation. https://www.mckinsey.com/capabilities/quantumblack/our-insights/the-state-of-ai

Sie möchten KI in Ihrem Unternehmen einsetzen und haben Fragen zur KI-Implementierung?

Gerne analysieren wir mit Ihnen in einem ersten unverbindlichen Strategiegespräch, wie der Einsatz von KI in Ihrem Unternehmen aussehen könnte und was dabei zu beachten ist.