Im ersten Teil dieser Serie haben wir herausgearbeitet, warum KI-Governance eine Führungsaufgabe ist [KI-Governance beginnt bei der Geschäftsführung]. In diesem Artikel widmen wir uns der daraus abgeleiteten Frage: Wie strukturiert man KI-Governance konkret? Dafür lohnt sich der Blick auf gleich drei komplementäre Frameworks, die jeweils eine andere Funktion erfüllen. Bevor wir diese vorstellen, gehen wir der Frage nach, wo KI-Governance im Unternehmen überhaupt verortet ist.

TL;DR:

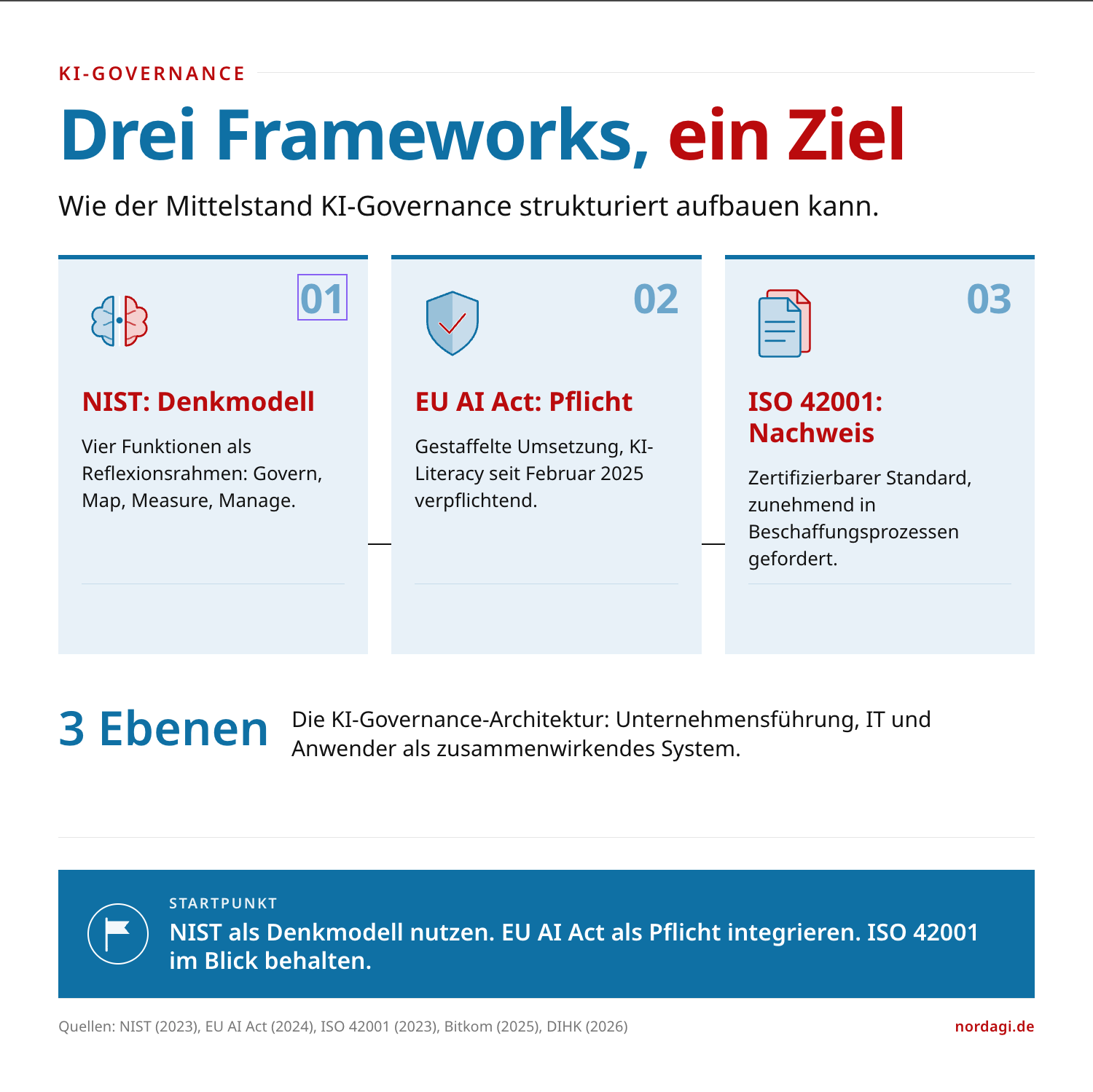

KI-Governance ist kein monolithisches Projekt, sondern eine Architektur, die drei Ebenen verbindet: Unternehmensführung, IT und Anwender. Drei Frameworks helfen bei der Umsetzung: Das NIST AI Risk Management Framework als Denkmodell, der EU AI Act als regulatorischer Rahmen und ISO/IEC 42001 als zertifizierbarer Standard. Entscheidend ist, dass Governance nicht nur Risiken systematisch minimiert, sondern auch den Rahmen dafür schafft, in dem KI-Chancen systematisch genutzt werden können.

Was ist eine KI-Governance-Architektur?

KI-Governance ist kein Einzelthema, das nur auf eine Abteilung beschränkt ist. Sie verteilt sich auf drei Ebenen im Unternehmen, die dabei unterschiedliche Aufgaben wahrnehmen und zusammenwirken.

Unternehmensführung: Auf dieser Ebene stehen die Themen Strategie und Steuerung im Vordergrund. Die Geschäftsführung wägt Risiken ab, aber auch, welche Chancen durch KI systematisch erschlossen werden sollen. Sie definiert die ethischen Leitplanken, benennt Verantwortlichkeiten und sorgt dafür, dass KI-Governance ein Bestandteil der gesamten Governance-Landschaft ist und in die Unternehmensstrategie eingebettet wird. [KI-Governance beginnt bei der Geschäftsführung]

IT: Diese Ebene umfasst organisationsweite Steuerung, IT-Sicherheit und den Support für die Anwender. Die IT-Abteilung stellt nicht nur die Infrastruktur bereit, sondern verwaltet auch Zugänge, sorgt für Datenschutzkonformität und unterstützt die Mitarbeitenden beim sicheren Einsatz von KI-Systemen. Sie ist die Brücke zwischen strategischer Vorgabe und operativer Nutzung.

Anwender: Hier findet die tatsächliche Arbeit mit KI statt. Mitarbeitende nutzen KI-Systeme, um bestehende Prozesse zu optimieren oder neue aufzubauen. Sie dokumentieren ihre Ergebnisse, identifizieren sinnvolle Automatisierungen und entdecken dabei häufig auch solche Anwendungsfälle, die auf strategischer Ebene noch nicht bedacht wurden. Genau hier entsteht oft der größte Wertschöpfungsbeitrag, auch dann, wenn bestehende Prozesse und deren Sinnhaftigkeit hinterfragt werden.

Drei Querschnittsthemen als Verbindungsglieder

Empowerment: Alle drei Ebenen benötigen die Kompetenz und die Befugnis, KI sinnvoll und sicher einzusetzen.

Ethische Grundsätze: Diese gelten auf jeder Ebene gleichermaßen, von der strategischen Entscheidung bis zur einzelnen Anwendung.

Chancen und Risiken: Governance bedeutet nicht nur, Risiken zu kontrollieren. Sie schafft auch den Rahmen, in dem ein Unternehmen die mit KI verbundenen Chancen systematisch identifizieren und nutzen kann, einschließlich solcher, die bisher nicht sichtbar sind. In der Fachsprache wird das als Imagination Gap bezeichnet: die Lücke zwischen dem, was KI leisten könnte, und dem, was Unternehmen sich derzeit vorstellen. [Imagination Gap]

Diese KI-Governance-Architektur beschreibt, wie ein Unternehmen aufgestellt ist. Die Frameworks, die wir im Folgenden vorstellen, sind die Werkzeuge, mit denen diese Architektur gefüllt werden kann.

Warum gibt es nicht ein einziges Framework für alles?

KI-Governance berührt unterschiedliche Dimensionen: Risiko- und Chancenmanagement, regulatorische Compliance, organisatorische Steuerung. Kein einzelnes Framework deckt alle drei vollständig ab. Da die Frameworks komplementär wirken, ist dies auch kein Mangel.

Ein Vergleich hilft: NIST liefert das Denkmodell (wie denken wir strukturiert über die mit dem KI-Einsatz verbundenen Risiken und Chancen nach?). Der EU AI Act liefert die regulatorischen Pflichten (was müssen wir tun?). ISO 42001 liefert das Managementsystem (wie weisen wir nach, dass wir es tun?).

Für den Mittelstand bedeutet das: Unternehmen müssen nicht alle drei Frameworks gleichzeitig implementieren. Aber sie sollten wissen, was jedes Framework leistet und wo es in der jeweiligen Governance-Architektur seinen Platz hat.

Was umfasst das NIST AI Risk Management Framework?

Das NIST AI Risk Management Framework 1.0 wurde im Januar 2023 vom US-amerikanischen National Institute of Standards and Technology veröffentlicht [1]. Es ist freiwillig, nicht präskriptiv und branchenübergreifend angelegt. In den USA hat es sich als De-facto-Standard für den verantwortungsvollen KI-Einsatz etabliert.

Das Framework basiert auf vier Kernfunktionen, die einen kontinuierlichen Zyklus bilden.

Govern bildet das Fundament. Wer trifft KI-Entscheidungen im Unternehmen? Welche Werte leiten diese Entscheidungen? Wie fließt Verantwortung? Wenn diese Grundlage schwach ist, funktioniert alles, was darauf aufbaut, nicht.

Map schafft Transparenz. Wer sind die Stakeholder der KI-Systeme? Nicht nur die Nutzer, sondern auch die Betroffenen. Was ist der gesamte Lebenszyklus einer KI-Anwendung? Wo liegt die Risikotoleranz des Unternehmens? Die Kernregel: Was nicht kartiert ist, kann auch nicht gesteuert werden.

Measure bewertet die Risiken. Nicht nur technisch, sondern auch qualitativ. Kontinuierliches Testen, Validierung unter realen Bedingungen, Szenarioanalysen. Wichtig: Die Betrachtung von Kennzahlen allein schützt nicht vor blinden Flecken. Deshalb ergänzt das Framework die quantitative Messung bewusst um eine qualitative Bewertung.

Manage priorisiert und handelt. Risiken werden mitigiert, akzeptiert, transferiert oder vermieden. Hier trifft Strategie auf Umsetzung.

Dann beginnt der Zyklus von vorn. Jede Iteration verbessert das Verständnis der eigenen KI-Landschaft und schärft gleichzeitig den Blick dafür, wo sich neue Einsatzmöglichkeiten eröffnen.

Was macht NIST für den DACH-Mittelstand relevant?

Der Wert von NIST liegt in seiner Denkstruktur. Die vier Kernfunktionen liefern eine Checkliste, die auch ein kleineres oder mittleres Unternehmen nutzen kann. Nicht als formales Audit, sondern als Reflexionsrahmen: Haben wir Governance definiert? Haben wir unsere KI-Landschaft kartiert? Messen wir, was wir steuern wollen? Handeln wir auf Basis der Ergebnisse?

Zudem hat NIST im Juli 2024 ein ergänzendes Profil für generative KI veröffentlicht (NIST AI 600-1) [1]. Gerade das ist relevant, da die meisten KI-Anwendungen im Mittelstand genau in diese Kategorie fallen: generative Textverarbeitung, Analyse-Tools oder KI-gestützte Assistenten.

Was verlangt der EU AI Act?

Der EU AI Act (Verordnung (EU) 2024/1689) ist seit August 2024 in Kraft. Anders als NIST ist er keine freiwillige Orientierung, sondern geltendes Recht. Die Umsetzung erfolgt gestaffelt [2].

Für den Mittelstand sind drei Zeitpunkte relevant:

Seit Februar 2025 gelten zwei Pflichten. Erstens: Bestimmte KI-Praktiken sind verboten, darunter Social Scoring und manipulative KI-Systeme. Zweitens: Artikel 4 verlangt KI-Literacy. Unternehmen, die KI einsetzen, müssen sicherstellen, dass ihre Mitarbeitenden über ausreichende KI-Kompetenz verfügen [3]. Diese Pflicht gilt bereits. Die Durchsetzung beginnt im August 2026.

Ab August 2026 greift die allgemeine Anwendbarkeit der Verordnung. Ab diesem Zeitpunkt können Sanktionen verhängt werden: bis zu 35 Millionen Euro oder 7 Prozent des weltweiten Jahresumsatzes, je nachdem, was höher ist.

Ab August 2027 gelten die Anforderungen für Hochrisiko-KI-Systeme in vollem Umfang: umfassende Dokumentation, Risikomanagement, Konformitätsbewertung.

Welche Risikostufen unterscheidet der EU AI Act?

Der EU AI Act unterscheidet vier Risikostufen. Die meisten KI-Anwendungen im Mittelstand fallen dabei in die beiden niedrigsten Kategorien.

Inakzeptables Risiko betrifft KI-Praktiken, die grundsätzlich verboten sind: Social Scoring, unterschwellige Manipulation, biometrische Echtzeit-Fernidentifizierung in öffentlichen Räumen. Für den Mittelstand ist diese Kategorie in der Regel nicht relevant, aber sie markiert die Grenze dessen, was der Gesetzgeber als nicht tolerierbar einstuft.

Hohes Risiko kommt im Mittelstand seltener vor: KI für finale Kreditentscheidungen, Personalauswahlsysteme ohne menschliche Überprüfung, sicherheitskritische Anwendungen. Hier greifen umfassende Dokumentations- und Aufsichtspflichten.

Begrenztes Risiko gilt etwa für KI-Chatbots im Kundenkontakt oder Vorauswahlsysteme für Bewerbungen, bei denen die finale Entscheidung beim Menschen bleibt. Nutzer müssen darüber informiert werden, dass sie mit einem KI-System interagieren.

Minimales Risiko betrifft den Großteil der gängigen KI-Tools: generative Textverarbeitung, KI für Buchhaltung, E-Mail-Klassifizierung. Die Anforderungen beschränken sich auf Transparenzhinweise.

Die relevante Erkenntnis: Die meisten Mittelständler werden wohl kein Compliance-Großprojekt benötigen, sehr wohl aber ein klares Verständnis dafür, wo ihre KI-Anwendungen einzuordnen sind, um eine dokumentierte Grundstruktur zu schaffen.

Warum verdient Artikel 4 besondere Beachtung?

Artikel 4 ist die am häufigsten unterschätzte Pflicht des EU AI Act. Er verlangt von allen Unternehmen, die KI nutzen oder bereitstellen, dass ihre Mitarbeitenden ausreichend KI-kompetent sind. Das klingt weich, hat aber konkrete Konsequenzen.

Laut Bitkom nennen 53 Prozent der deutschen Unternehmen fehlende Kompetenz als größtes Hemmnis beim KI-Einsatz [4]. Das ist nicht nur ein Produktivitätsproblem, sondern kann auch zu einem Compliance-Risiko werden.

Umgekehrt betrachtet liegt hier auch eine Chance: Unternehmen, die frühzeitig in KI-Kompetenz investieren, erfüllen nicht nur die regulatorische Anforderung. Sie schaffen die Voraussetzung dafür, dass KI im Arbeitsalltag tatsächlich produktiv eingesetzt wird und Mitarbeitende Einsatzmöglichkeiten erkennen, die auf strategischer Ebene bisher nicht sichtbar waren.

Die gute Nachricht: Die Anforderungen sind flexibel. Es gibt keinen vorgeschriebenen Lehrplan. Die EU-Kommission betont ausdrücklich, dass die Maßnahmen kontextabhängig sein sollen [3]. Für einen Mittelständler kann das bedeuten: dokumentierte interne Schulungen, regelmäßige Sensibilisierung, klare Nutzungsrichtlinien. [KI-Kompetenzen – Was Führungskräfte wirklich können müssen]

Warum wird ISO/IEC 42001 zunehmend wichtig?

ISO/IEC 42001 wurde im Dezember 2023 veröffentlicht und ist der erste internationale Standard für KI-Managementsysteme [5]. Er ist das KI-Äquivalent zu ISO 27001 für Informationssicherheit: zertifizierbar, auditierbar und zunehmend als Nachweis für Governance-Reife gefordert.

Für den Mittelstand ist ISO 42001 aus einem bestimmten Grund relevant: Große Unternehmen beginnen, die Zertifizierung in ihren Beschaffungsprozessen zu verlangen. Wer als Zulieferer oder Dienstleister für größere Auftraggeber arbeitet, könnte mittelfristig vor der Frage stehen, ob er ISO 42001-Konformität nachweisen muss und kann.

Das ist nicht nur ein Compliance-Thema. Es ist auch eine Chance zur Differenzierung. Wer frühzeitig nachweisen kann, dass KI-Governance strukturiert umgesetzt wird, verschafft sich einen Vorteil bei Geschäftspartnern und Endkunden, die zunehmend Wert auf den verantwortungsvollen Umgang mit KI legen.

Das bedeutet nicht, dass jeder Mittelständler sofort eine Zertifizierung anstreben muss. Aber es bedeutet, dass die Strukturen, die ISO 42001 fordert, sinnvolle Governance-Grundlagen sind: definierte Verantwortlichkeiten, dokumentierte Prozesse, regelmäßige Überprüfung, Stakeholder-Einbindung.

Wie hängen die drei Frameworks zusammen?

NIST liefert das konzeptionelle Fundament. Die vier Funktionen (Govern, Map, Measure, Manage) strukturieren das Denken über KI-Risiken und KI-Chancen gleichermaßen. Das ist der Startpunkt.

EU AI Act übersetzt einen Teil dieser Denkstruktur in verbindliche Pflichten. Wer NIST als Orientierung nutzt, wird feststellen, dass viele EU-AI-Act-Anforderungen bereits abgedeckt sind. Die DIHK hat in ihrer Stellungnahme zum deutschen Umsetzungsgesetz (KI-MIG) darauf hingewiesen, dass die Zuständigkeitsstrukturen noch intransparent und komplex sind [6]. Ein eigenes Governance-Fundament hilft, diese Komplexität zu navigieren.

ISO 42001 formalisiert das Ganze in einem auditierbaren Managementsystem. Es ist der Schritt von „Wir haben Governance“ zu „Wir können Governance nachweisen“.

Für einen Mittelständler könnte ein pragmatischer Weg so aussehen: NIST als Denkmodell nutzen, um die eigene KI-Governance-Architektur aufzubauen. Die EU-AI-Act-Anforderungen als verbindlichen Mindeststandard integrieren. ISO 42001 als langfristige Orientierung im Blick behalten, besonders wenn die eigene Kundenstruktur in Richtung Zertifizierungsnachweise geht.

Was als Erstes tun?

Die wichtigste Maßnahme ist eine Bestandsaufnahme: Welche KI-Systeme sind im Einsatz? In welche Risikokategorie fallen sie? Wer verantwortet ihre Nutzung? Und ebenso wichtig: Wo liegen die größten Potenziale für produktivere Prozesse oder neue Prozesse, die zu mehr Wertschöpfung führen? Diese Bestandsaufnahme entspricht der „Map“-Funktion von NIST und bildet gleichzeitig die Grundlage für die EU-AI-Act-Einordnung.

Der zweite Schritt betrifft die KI-Literacy gemäß Artikel 4. Dokumentieren Sie, welche Schulungen und Sensibilisierungsmaßnahmen Sie durchführen. Nicht als bürokratische Pflicht, sondern als Grundlage für den kompetenten KI-Einsatz in Ihrem Unternehmen.

Der dritte Schritt ist ein Governance-Setup: eine benannte verantwortliche Person, dokumentierte Nutzungsrichtlinien, eine regelmäßige Überprüfung. Das muss kein riesiges Compliance-Programm sein. Es muss ein funktionierender und robuster Rahmen sein, der sowohl Risiken adressiert als auch Raum für neue Möglichkeiten schafft.

Im dritten Teil dieser Serie zeigen wir, wo die unsichtbaren Governance-Lücken liegen: bei KI, die Ihre Mitarbeitenden bereits nutzen, ohne dass Sie es wissen, und bei KI, die in Ihrer SaaS-Landschaft eingebettet ist, ohne dass Sie sie inventarisiert haben.

Quellen:

[1] NIST AI Risk Management Framework 1.0 (AI RMF), veröffentlicht am 26. Januar 2023. NIST AI 600-1 (Generative AI Profile), veröffentlicht im Juli 2024. URL: https://www.nist.gov/itl/ai-risk-management-framework

[2] EU AI Act (Verordnung (EU) 2024/1689), in Kraft seit 1. August 2024. URL: https://artificialintelligenceact.eu/implementation-timeline

[3] EU-Kommission, AI Literacy Q&A. URL: https://digital-strategy.ec.europa.eu/en/faqs/ai-literacy-questions-answers

[4] Bitkom, Künstliche Intelligenz 2025, veröffentlicht Februar 2026. Befragung von 604 Unternehmen ab 20 Beschäftigten. URL: https://www.bitkom.org/Bitkom/Publikationen/Kuenstliche-Intelligenz-in-Deutschland

[5] ISO/IEC 42001:2023, Artificial Intelligence Management System. URL: https://www.iso.org/standard/81230.html

[6] DIHK-Stellungnahme zum KI-MIG, März 2026. Die DIHK kritisiert, dass die Marktüberwachungsstrukturen in Teilen intransparent und schwer nachvollziehbar sind.

Dieser Artikel ist Teil 2 der Serie „KI-Governance im Mittelstand“. Teil 1 behandelt die Führungsverantwortung, Teil 3 die unsichtbaren Risiken von Schatten-KI, Vendor-KI und Agentic AI.

Sie möchten KI in Ihrem Unternehmen einsetzen und haben Fragen zur KI-Implementierung?

Gerne analysieren wir mit Ihnen in einem ersten unverbindlichen Strategiegespräch, wie der Einsatz von KI in Ihrem Unternehmen aussehen könnte und was dabei zu beachten ist.