Laut Bitkom hat sich der Anteil der Unternehmen, die KI einsetzen, innerhalb eines Jahres mehr als verdoppelt und liegt den letzten Zahlen nach bei 41 Prozent [1]. Die DIHK-Digitalisierungsumfrage 2026 zeigt, dass 59 Prozent der Unternehmen unter anderem rechtliche Unsicherheiten als zentrale Herausforderung beim KI-Einsatz sehen [2]. Die Zahlen weisen also nicht nur auf eine zunehmende KI-Nutzung, sondern gleichzeitig auch auf eine mögliche Governance-Lücke hin. Hat diese ihren Ursprung eventuell darin, dass die Strukturen zur Kontrolle der KI-Nutzung langsamer wachsen als die KI-Nutzung selbst? Wer trägt schlussendlich die Verantwortung für den KI-Einsatz? Die IT-Abteilung oder die Geschäftsführung? Die einfache Antwort: Beide, aber in unterschiedlichen Rollen.

TL;DR:

KI-Governance ist schon jetzt eine Führungsaufgabe. Die IT-Abteilung trägt die operative Verantwortung für Infrastruktur und Sicherheit. Aber die strategischen Entscheidungen – Risikotoleranz, Verantwortungsstrukturen, Urteilsfähigkeit – liegen bei der Geschäftsführung. Dieser Artikel zeigt, wo die blinden Flecken entstehen, warum Governance über die eigenen Tools hinausreichen muss und welche Kompetenzen die Unternehmensführung dafür benötigt.

Warum ist KI-Governance keine Aufgabe, die auf die IT-Abteilung beschränkt ist?

Es scheint einfach zu sein: KI ist letztlich „auch nur Software“ und deshalb ist die IT-Abteilung zuständig. Diese Annahme ist ein zweischneidiges Schwert, denn sie vermischt operative Umsetzung und die Verantwortung dafür auf der Ebene der IT-Abteilung mit strategischer Verantwortung, die bei der Unternehmensführung angesiedelt ist.

Die IT-Abteilung kann technische Infrastruktur bereitstellen, Tools administrieren und Sicherheitsstandards umsetzen. Aber KI-Governance erfordert auch Entscheidungen, die über die Technik hinausreichen: Welche Risiken ist das Unternehmen bereit einzugehen? Welche Prozesse dürfen automatisiert werden und welche nicht? Wer kontrolliert und wer verantwortet die Ergebnisse, die von einem KI-System erzeugt werden? Das geht über den Scope von operativer Umsetzung hinaus und ist am Ende eine Führungsentscheidung.

Den Kontext dazu liefert unter anderem Kate Kellogg, ihres Zeichens Professorin am MIT Sloan, die in einer Studie zu Agentic-AI-Projekten folgende Beobachtungen machte: Bei einem KI-Projekt im klinischen Bereich entfielen 80 Prozent des Aufwands nicht etwa auf die Technologieimplementierung, sondern auf Stakeholder-Alignment, Governance und Workflow-Integration [3]. Um wieder auf die Aufgabenverteilung zurückzukommen: Die erforderlichen Nutzungsrichtlinien zu definieren, Verantwortungsstrukturen aufzubauen und Akzeptanz in der Organisation zu schaffen, sind keine IT-Aufgaben, sondern Führungsaufgaben.

Wo liegen die blinden Flecken der Unternehmensführung?

Wenn KI-Governance eine Führungsaufgabe ist, wie wird sie dann im Unternehmen umgesetzt? Hier kann es zu einem strukturellen blinden Fleck in der Aufgabenwahrnehmung kommen.

Um strategische KI-Entscheidungen treffen zu können, muss die Unternehmensführung dazu befähigt werden. Nicht durch technisches Detailwissen, sondern durch Entscheidungskompetenz: Wer KI-Governance verantworten soll, muss einordnen können, was KI-Systeme leisten können, wo ihre Grenzen liegen und welche Risiken mit ihrem Einsatz verbunden sind. Im Idealfall sollte die Unternehmensführung selbst Erfahrung in der Nutzung von KI-Systemen mitbringen, um die Tragweite ihrer Entscheidungen einschätzen zu können.

In der Praxis werden KI-bezogene Entscheidungen im Mittelstand oft bei einer Person konzentriert, häufig bei der Geschäftsführung selbst. Das ist zunächst naheliegend. Aber es wirft eine Frage auf: Hat diese Person das vollständige Bild? Weiß sie, welche KI-Systeme wo im Einsatz sind? Kennt sie die Grenzen der eingesetzten Systeme? Sieht sie, wo Mitarbeitende KI-Tools nutzen, ohne dass dies dokumentiert ist?

Hier entsteht eine Dualität, die typisch für den Mittelstand ist. Die eigene Arbeitsweise wird als pragmatisch und funktionierend wahrgenommen. Entscheidungen werden schnell getroffen, das Unternehmen läuft. Von außen betrachtet, etwa durch Kunden, Geschäftspartner oder bei einer Due-Diligence-Prüfung, kann dieselbe Herangehensweise als fehlende Governance wahrgenommen werden. Das sind zwei Seiten einer Medaille: Es funktioniert operativ, aber es fehlt die dokumentierte und dokumentierende Struktur, die das Funktionieren auch nachweisbar und übertragbar macht und damit einen verbindlichen Rahmen bildet.

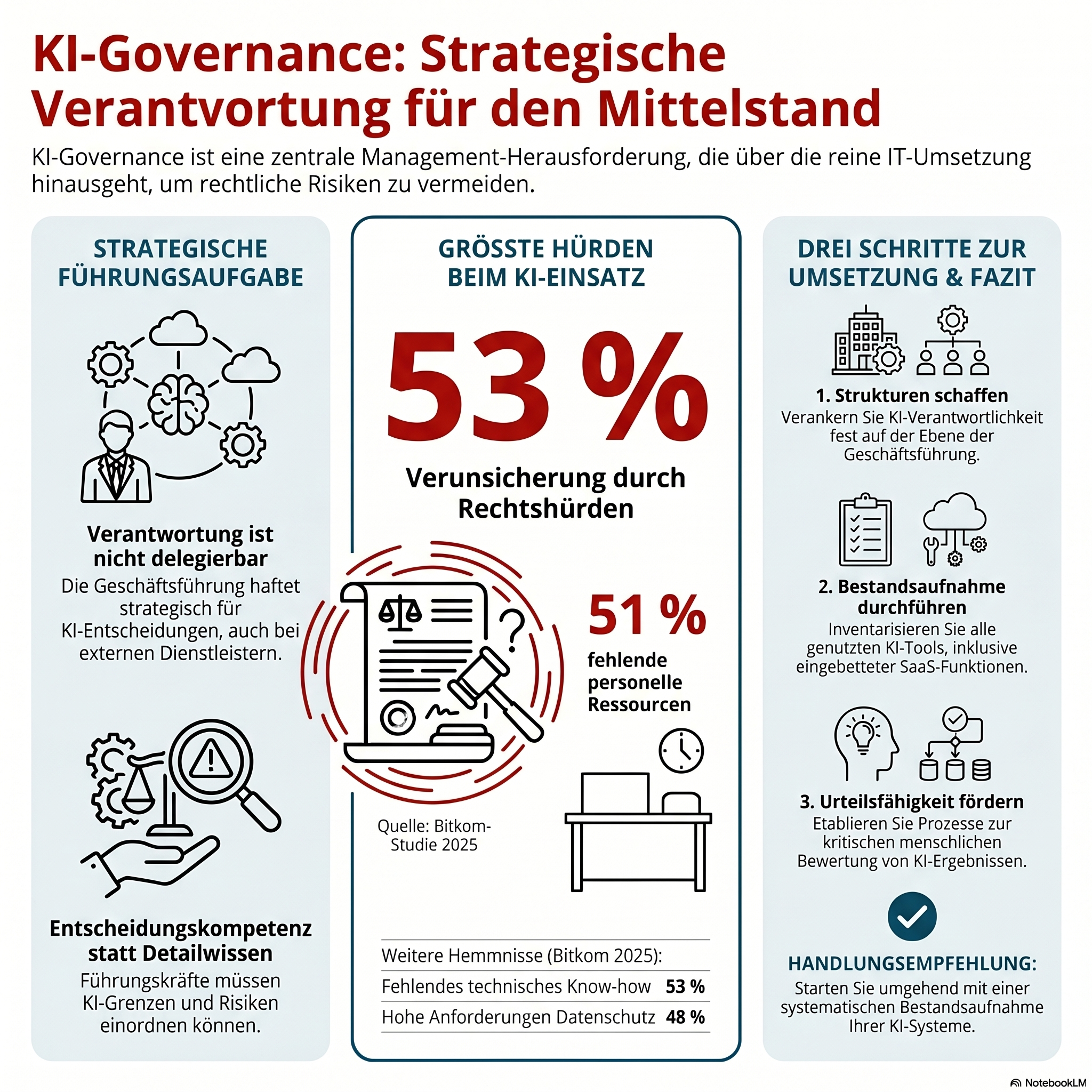

Dazu kommt: Die Hemmnisse beim KI-Einsatz sind vielfältig und betreffen nicht nur die Technik. Eine Bitkom-Studie aus dem Jahr 2025 zeigt ein dementsprechend differenziertes Bild. 53 Prozent der befragten Unternehmen nennen die Verunsicherung durch rechtliche Hürden und damit verbundene Unklarheiten als größtes Hemmnis. Gleichauf liegen mit 53 Prozent fehlendes technisches Know-how. 51 Prozent beklagen fehlende personelle Ressourcen, 48 Prozent die hohen Anforderungen an den Datenschutz, und 38 Prozent die mangelnde Nachvollziehbarkeit der KI-Ergebnisse [4]. Das sind keine rein technischen Probleme mehr. Es sind Herausforderungen, die strategische Entscheidungen, Priorisierung und Ressourcenallokation erfordern. Und das rückt sie in die Verantwortungssphäre der Geschäftsführung.

Wie weit muss KI-Governance reichen?

KI-Governance betrifft nicht nur die offensichtlichen KI-Tools, die ein Unternehmen beschafft und einsetzt. Tatsächlich reicht sie oftmals viel weiter. Beispielsweise bis in die Systeme von Dienstleistern, SaaS-Anbietern und Zulieferern. Die Frage ist: Wer trägt die Verantwortung für die Auswirkungen mit, wenn ein HR-System, ein CRM oder eine Buchhaltungssoftware, die im Unternehmen verwendet wird, KI-Funktionen einsetzt?

Wenn KI-Entscheidungen im Namen des Unternehmens getroffen werden, dann bleiben es Entscheidungen des Unternehmens. Unabhängig davon, ob die Technologie intern oder extern betrieben wird. [KI-Entscheidungen im Unternehmen: Warum der Mensch die letzte Instanz bleiben muss]

Wenn öffentlich wird, dass ein Unternehmen KI-gestützte Entscheidungen trifft, die sich als fehlerhaft, diskriminierend oder auf andere Weise unethisch herausstellen, entsteht der Reputationsschaden unmittelbar. Kunden, Bewerber und Geschäftspartner sind bereits sensibilisiert.

Das illustriert der Fall Workday, bei dem offensichtlich wird, wie schnell sich ein solches Risiko konkretisieren kann. Das US-Unternehmen bietet eine KI-gestützte Bewerber-Screening-Software an, die von zahlreichen Unternehmen genutzt wird. Ein Bewerber, der über 100 Bewerbungen eingereicht hatte und jedes Mal abgelehnt wurde, teils innerhalb von Minuten, klagte wegen systematischer Altersdiskriminierung. Im Mai 2025 ließ ein US-Gericht die Klage als landesweite Sammelklage zu [5]. Die Unternehmen, die Workday nutzten, gingen davon aus, der Anbieter würde die Compliance sicherstellen. Das Gericht prüft nun, ob Workday als „Agent“ des Arbeitgebers agiert, was bedeuten würde, dass der Anbieter und die Unternehmen gemeinsam haften könnten.

Auch wenn dieser Fall im US-Rechtssystem zu verorten ist, bleibt die Grundsatzfrage gleich: Wer überwacht die KI‑Ergebnisse? Wer stellt sicher, dass die Entscheidungen konform mit dem eigenen ethischen Anspruch getroffen werden? Die Verantwortung dafür kann nicht delegiert werden.

Was verändert sich durch KI an Führungsaufgaben und was bedeutet das für den Mittelstand?

Neben den Herausforderungen rund um Compliance und Risikomanagement entstehen weitere Führungsaufgaben. Generative KI kann Wissen in einer Qualität und Geschwindigkeit erzeugen, die vor Kurzem noch unvorstellbar war. Texte, Analysen, strategische Optionen entstehen in Sekunden. Was dabei leicht übersehen wird: Dieses Wissen ist zunehmend entkoppelt von Erfahrung und Kontext.

KI ersetzt primär explizites, formales Wissen. Das Wissen, das erlernt und weitergegeben werden kann. Was sie nicht ersetzt, ist implizites Wissen. Also Erfahrungswissen, das dann greift, wenn es keine eindeutige Antwort gibt, weil eben nicht alle Randbedingungen geklärt sind. Der Umgang mit diesem impliziten Wissen wird damit zu einer zentralen Führungskompetenz.

Wenn dank KI alle Antworten jederzeit verfügbar sind, dann ist die Konsequenz daraus, dass nicht mehr die Person mit dem meisten Wissen zur wichtigsten im Raum wird, sondern diejenige, die am besten beurteilen kann, wie dieses Wissen einzuordnen und anzuwenden ist. Es gibt eine Verschiebung von Faktenwissen hin zu Einordnung, Bewertung und der daraus entstehenden Entscheidungskompetenz. [KI als Sparringspartner – wie Führungskräfte ein echtes Gegenüber gewinnen]

Diese Verschiebung hat direkte Governance-Konsequenzen. Wenn KI-Ergebnisse nicht als automatisch vertrauenswürdig einzustufen sind, dann benötigt das Unternehmen Strukturen, die festlegen, bei welchen Entscheidungen eine menschliche Prüfung der Ergebnisse zwingend erforderlich wird. Strukturen, die festlegen, welche KI-Empfehlungen verworfen oder bestätigt werden, und eine klare Dokumentation dazu. Auch wenn dies zunächst abstrakt klingen mag, handelt es sich dabei um die Grundlagen funktionierender KI-Governance.

Um die Umsetzung dieser Governance-Anforderungen sicherzustellen, muss sich die Geschäftsführung ihre Handlungsfähigkeit bewahren. Drei Themenfelder stehen dabei im Fokus.

Erstens: Verantwortung nicht delegieren, sondern strukturieren. KI-Governance muss auf der Geschäftsführungsebene verankert werden. Das bedeutet nicht, dass die Geschäftsführung selbst jedes Detail steuert. Es bedeutet, dass die erforderlichen Strukturen geschaffen werden, die zu verantwortungsbewussten Entscheidungen führen. Im Mittelstand mit 50 bis 250 Mitarbeitern ist das oft die Geschäftsführung selbst.

Zweitens: Überblick schaffen. Viele Unternehmen wissen nicht, welche KI-Systeme bereits im Einsatz sind. Mitarbeitende nutzen KI-Tools über private Accounts, SaaS-Produkte enthalten eingebettete KI-Funktionen, die nie inventarisiert wurden. Der erste Governance-Schritt ist daher eine Bestandsaufnahme: Welche KI-Systeme nutzen wir? Wofür? Wer verantwortet die Ergebnisse? [KI-Resilienz]

Drittens: Das Prinzip, nach dem Urteilsfähigkeit und Ergebnisbewertung eine Führungskompetenz ist, erfährt eine Erweiterung bei der kritischen Bewertung von KI-Ergebnissen. Das erfordert kein technisches Detailwissen, sondern die Fähigkeit, die richtigen Fragen zu stellen. Wann kann ich mich auf eine KI-Empfehlung verlassen? Wann nicht? An welchen Stellen ist zusätzliche menschliche Expertise erforderlich, um zu einer abschließenden Einordnung der Ergebnisse zu gelangen?

Wie steht es um die regulatorischen Anforderungen?

Im regulatorischen Umfeld lohnt neben dem Blick auf nationale Anforderungen auch einer auf den EU AI Act. Seit Februar 2025 gilt Artikel 4: Unternehmen, die KI einsetzen, müssen sicherstellen, dass ihre Mitarbeitenden über ausreichende KI-Kompetenz verfügen [6]. Ab August 2026 greifen die Durchsetzungsmechanismen, verbunden mit einem empfindlichen Sanktionsrahmen.

Für die meisten KI-Anwendungen im Mittelstand sind die Anforderungen jedoch moderat: Transparenz, Dokumentation, menschliche Aufsicht. Aber auch moderate Anforderungen benötigen jemanden, der sie verantwortet und die Umsetzung sicherstellt.

Im zweiten Teil dieser Serie betrachten wir die konkreten Frameworks, die bei der strukturierten Umsetzung helfen: das NIST AI Risk Management Framework, den EU AI Act und ISO/IEC 42001. Nicht als theoretische Übung, sondern als pragmatische Orientierung für den Mittelstand.

Quellen:

[1] Bitkom, Künstliche Intelligenz in Deutschland, Studienbericht 2026, basierend auf 604 Unternehmen ab 20 Beschäftigten. URL: https://www.bitkom.org/Bitkom/Publikationen/Kuenstliche-Intelligenz-in-Deutschland

[2] DIHK-Digitalisierungsumfrage 2026, knapp 5000 Unternehmen aller Branchen. URL: https://www.dihk.de/de/themen-und-positionen/wirtschaft-digital/digitalisierung/dihk-digitalisierungsumfrage-2026

[3] Kellogg, K. et al. (2025), zitiert in: MIT Sloan, „Agentic AI, explained“, Februar 2026. URL: https://mitsloan.mit.edu/ideas-made-to-matter/agentic-ai-explained

[4] Bitkom, Künstliche Intelligenz 2025, veröffentlicht Februar 2026. Befragung von 604 Unternehmen ab 20 Beschäftigten (Feldphase KW 27-32, 2025). URL: https://www.bitkom.org/Bitkom/Publikationen/Kuenstliche-Intelligenz-in-Deutschland

[5] Mobley v. Workday, Inc., N.D. Cal. Case No. 23-cv-00770-RFL. URL: https://www.courtlistener.com/docket/66831340/mobley-v-workday-inc/

[6] EU AI Act, Verordnung (EU) 2024/1689, Artikel 4: KI-Literacy. URL: https://artificialintelligenceact.eu/article/4/

Dieser Artikel ist Teil 1 der Serie „KI-Governance im Mittelstand“. Teil 2 behandelt die relevanten Frameworks (NIST, EU AI Act, ISO 42001), Teil 3 die unsichtbaren Risiken von Schatten-KI, Vendor-KI und Agentic AI.

Sie möchten KI in Ihrem Unternehmen einsetzen und haben Fragen zur KI-Implementierung?

Gerne analysieren wir mit Ihnen in einem ersten unverbindlichen Strategiegespräch, wie der Einsatz von KI in Ihrem Unternehmen aussehen könnte und was dabei zu beachten ist.

KI-Governance Frameworks: NIST, EU AI Act, ISO 42001 für den Mittelstand | NordAGI

[…] ersten Teil dieser Serie haben wir herausgearbeitet, warum KI-Governance eine Führungsaufgabe ist [KI-Governance beginnt bei der Geschäftsführung]. In diesem Artikel widmen wir uns der daraus abgeleiteten Frage: Wie strukturiert man […]